Extrait

Le texte complet est en téléchargement en bas de page

Les récits précédents alertent sur les dangers d’une IA addictive et sur la nécessité absolue d’une prévention des conduites à risque et d’un encadrement juridique de cette technologie. Nous synthétisons ici les principaux risques avérés et exposons la tension entre l’exigence de régulation face à la réticence des éditeurs soutenus par l’administration Trump au prétexte d’un embarras mis à l’essor de cette technologie disruptive que les Etats-Unis d’Amérique entendent dominer sans partage.

Dans une annexe, nous présentons les principaux éditeurs d’IA évoqués dans ces pages et leurs prises de positions publiques sur le sujet des risques sociétaux obvies dont ce livre se fait le reflet.

Disons, une fois de plus, ici que l’IA est une technologie logicielle qui connaît des progrès spectaculaires, année par année, voire mois par mois, et que l’image figée que donne cet ouvrage est celui des dérives observées principalement en 2025, en particulier provoquées par la version 4 insuffisamment testée du logiciel ChatGPT qui s’est révélée être à l’origine de psychoses, au point que OpenAI ait décidé le 29 janvier 2026 de la retirer du marché.

Matt Shumer dans Fortune souligne cette obsolescence : « Les modèles disponibles aujourd’hui sont méconnaissables par rapport à ceux d’il y a seulement six mois. Le débat sur la question de savoir si l’IA « progresse réellement » ou « atteint un plafond » — qui dure depuis plus d’un an — est clos. C’est terminé. Quiconque soutient encore cet argument n’a soit pas utilisé les modèles actuels, soit a intérêt à minimiser la situation, soit fonde son évaluation sur une expérience de 2024 qui n’est plus pertinente. Je ne dis pas cela par mépris. Je le dis parce que le fossé entre la perception du public et la réalité actuelle est désormais énorme, et ce fossé est dangereux… car il empêche les gens de se préparer. »

Depuis les graves et multiples incidents dont la presse s’est faite l’écho, et face aux actions en justice intentées par les victimes et leurs familles, les éditeurs ont, pour partie, mais pour partie seulement, corrigé les biais sycophantiques de leurs solutions mais, parce que le risque demeure de délusion provoquée et/ou entretenue par les IA, et parce que le débat sur la régulation reste ouvert, notre mise en alerte nous semble salutaire et actuelle.

Certains zélateurs, pour ne pas dire adorateurs de l’IA, rejetteront le principe même de cet ouvrage au motif qu’il polémique sur des faits isolés, des aberrations largement imputables à des utilisateurs d’ores et déjà fragiles, pour lequel l’IA ne saurait être coupable d’avoir causé leur mal-être mais seulement l’avoir mis en lumière. Ces promoteurs de la 5e révolution industrielle plaideront les progrès fantastiques permis par l’IA dans le domaine de la médecine, de la recherche… citerons mille cas de personnes ayant trouvé dans un ami de cœur virtuel un réconfort. Tout cela est vrai mais n’enlève rien à la responsabilité historique des éditeurs, celle d’avoir commercialisé des agents conversationnels biaisés par une sycophantie systématique, paramétrée pour flatter et non réfuter les délires des utilisateurs.

Des monographies des principaux éditeurs en annexe, documentent les comportements à risque de certains éditeurs et, leurs réponses parfois ambigües, prétendant protéger la santé morale de leurs clients mais laissant perdurer des biais paramétrés, volontaires, pour les rendre dépendants et augmenter leurs revenus. La controverse autour des publicités ciblées introduites par OpenAI, après les avoir exclues, et le refus d’un Anthropic de marchandiser ainsi leur trafic, et plus généralement, la question de la protection des données individuelles très détaillées captées par les agents conversationnels illustre l’exigence absolue d’une régulation de ce qui est aujourd’hui, très largement, un Far West, en particulier aux Etats-Unis d’Amérique de par la doctrine très explicite de Donald Trump.

Indiquons également que l’auteur a pris l’attache de Julie Lavet en charge des relations publiques pour OpenAI Europe par un mail en date du 25 janvier 2026 lui indiquant le contenu et le titre de l’ouvrage et lui proposant de présenter le point de vue d’OpenAI, courriel resté sans réponse.

La littérature sur le sujet étant immense, nous renvoyons le chercheur à la consultation des références mises en lien hypertexte.

Puisse cet ouvrage sembler dans quelques années une archéologie d’une IA encore adolescente et largement immaîtrisée de l’aveu même de ses concepteurs.

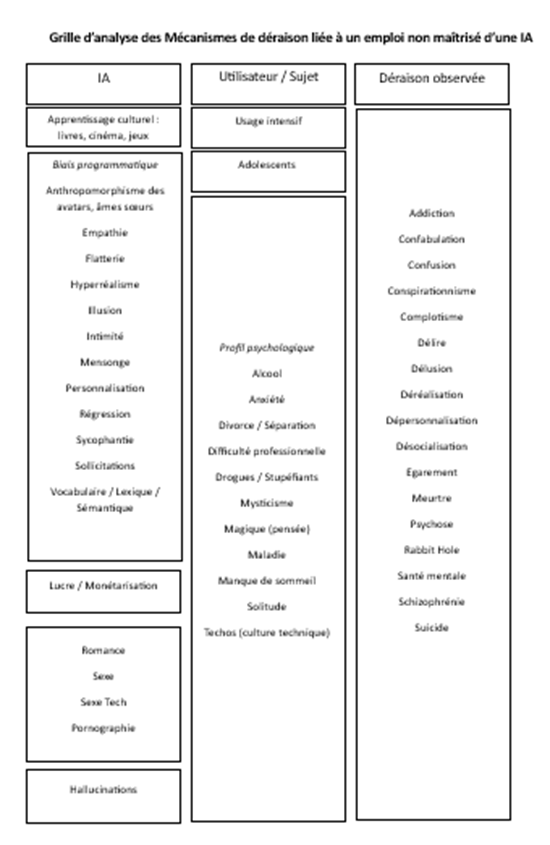

Grille d’analyse des leviers et des effets d’une IA addictive

Nous proposons un schéma de causalité, présentant, de manière résumée et simplifiée, l’articulation entre les biais programmatiques, les dérives psychologiques observées et les profils des victimes qui les prédisposaient à des troubles de la raison qui ont été aggravés voire causés par l’IA.

- Allan Brooks qui crut être devenu un inventeur de génie

- Stein-Erik Soelberg qui tua sa mère se croyant victime d’un complot

- Adam Raine qui se suicida.